Co je technologie velkých dat?

Jak víme, data se neustále vyvíjejí. Růst dat vyzval lidské mozky, aby je extrahovaly, analyzovaly a řešily. Je to proto, že tradiční způsoby nakládání s daty nepodporují tato velká data. Velká data jsou popsána obvykle třemi pojmy: objem, rozmanitost a rychlost.

Data se nyní stala nejdůležitějším aktivem každé společnosti. Analýza těchto velkých dat pomáhá společnosti analyzovat chování jejich zákazníků a předpovídat relevantní věci spojené s těmito rozhodnutími založenými na údajích, aby organizace učinila organizaci, podnikla sebevědomější kroky a vytvořila silnější strategie.

Vzhledem k tomu, jak rychle rostou data v dnešní době, budou velká data v blízké budoucnosti obrovským polem pro práci. Všichni studenti, osvěžení, profesionálové budou potřebovat, aby se udržovali v aktuálním stavu s novými technologiemi velkých dat. Udržet se v aktuálním stavu přinese skvělou a úspěšnou kariéru na své profesionální cestě.

Technologie velkých dat

Zde uvádím několik velkých datových technologií s jasným vysvětlením, abych vás upozornil na nadcházející trendy a technologie:

-

Apache Spark:

Je to rychlý nástroj pro zpracování velkých dat. To je postaveno s ohledem na zpracování dat v reálném čase. Jeho bohatá knihovna Strojového učení je dobrá pro práci v prostoru AI a ML. Zpracovává data paralelně a na clusterových počítačích. Základním datovým typem používaným programem Spark je RDD (odolná distribuovaná datová sada).

-

NoSQL databáze:

Jedná se o nerelační databáze, které umožňují rychlé ukládání a vyhledávání dat. Jeho schopnost vypořádat se se všemi druhy dat, jako jsou strukturovaná, polostrukturovaná, nestrukturovaná a polymorfní data, je jedinečná. Žádné databáze SQL nejsou následujících typů:

- Databáze dokumentů : Ukládá data ve formě dokumentů, které mohou obsahovat mnoho různých párů klíč-hodnota.

- Obchody s grafy : Ukládá data, která se obvykle ukládají ve formě sítě, například data sociálních médií.

- Úložiště klíč-hodnota : Jedná se o nejjednodušší databáze NoSQL. Každá a každá jednotlivá položka v databázi je uložena jako název atributu (nebo „klíč“) spolu s její hodnotou.

- Obchody se širokými sloupci : Tato databáze ukládá data ve sloupcovém formátu, nikoli ve formátu založeném na řádcích. Cassandra a HBase jsou dobrými příklady.

-

Apache Kafka:

Kafka je distribuovaná platforma pro streamování událostí, která každý den zpracovává mnoho událostí. Vzhledem k tomu, že je rychlý a škálovatelný, je to užitečné při vytváření datových potrubních toků v reálném čase, které spolehlivě načítají data mezi systémy nebo aplikacemi.

-

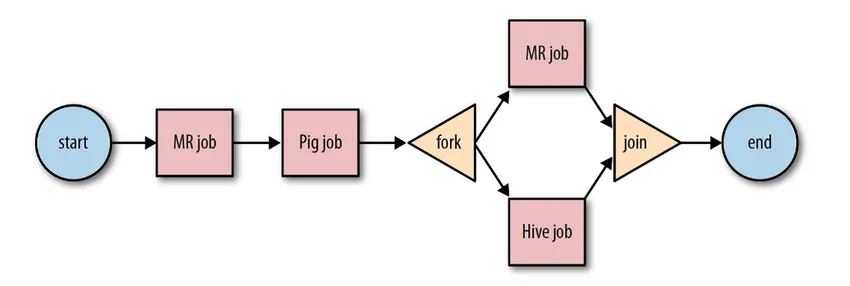

Apache Oozie:

Je to systém plánovače pracovních toků pro správu úloh Hadoop. Tyto úlohy pracovního postupu jsou pro akce naplánovány ve formě řízených acyklických grafů (DAG).

Zdroj: Google

Jeho škálovatelné a organizované řešení pro velké datové aktivity.

-

Apache Airflow:

Toto je platforma, která naplánuje a sleduje pracovní postup. Inteligentní plánování pomáhá při efektivní organizaci konce provádění projektu. Airflow má schopnost znovu spustit instanci DAG, když dojde k selhání. Jeho bohaté uživatelské rozhraní usnadňuje vizualizaci potrubí běžících v různých fázích, jako je výroba, sledování pokroku a odstraňování problémů, pokud je to potřeba.

-

Apache Beam:

Jedná se o sjednocený model, který definuje a provádí potrubí pro zpracování dat, které zahrnují ETL a nepřetržité streamování. Rámec Apache Beam poskytuje abstrakci mezi logikou vaší aplikace a ekosystémem velkých dat, protože neexistuje žádné API, které by vázalo všechny rámce, jako je Hadoop, jiskra atd.

-

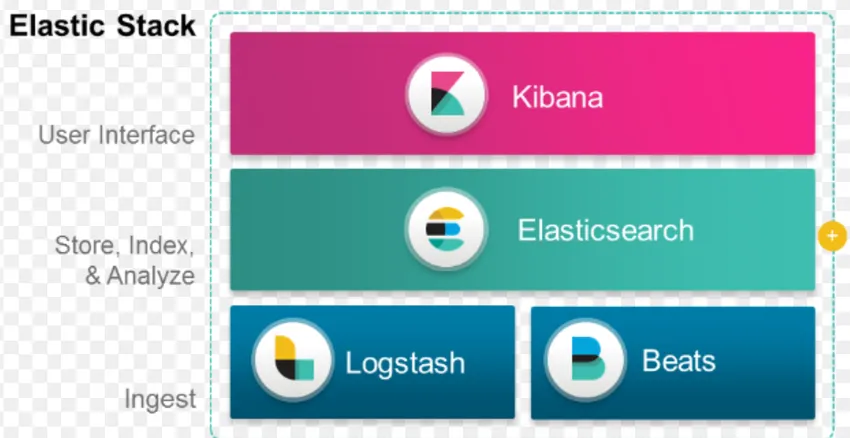

Zásobník ELK:

ELK je známá pro Elasticsearch, Logstash a Kibana.

Elasticsearch je databáze bez schématu (která indexuje každé pole), která má výkonné možnosti vyhledávání a snadno škálovatelná.

Logstash je nástroj ETL, který nám umožňuje načítat, transformovat a ukládat události do Elasticsearch.

Kibana je nástroj dashboardingu pro Elasticsearch, kde můžete analyzovat všechna uložená data. Realizovatelné poznatky získané z Kibany pomáhají při budování strategií pro organizaci. Od zachycení změn k predikci se Kibana vždy osvědčila jako velmi užitečná.

-

Docker a Kubernete:

Toto jsou vznikající technologie, které pomáhají aplikacím běžet v linuxových kontejnerech. Docker je sbírka nástrojů s otevřeným zdrojovým kódem, které vám pomohou „Sestavit, odeslat a spustit libovolnou aplikaci kdekoli“.

Kubernetes je také open source platforma / orchestrační platforma, která umožňuje velké množství kontejnerů spolupracovat v harmonii. To nakonec snižuje provozní zatížení.

-

TensorFlow:

Je to otevřená knihovna strojového učení, která se používá k navrhování, stavbě a trénování hlubokých modelů učení. Všechny výpočty jsou prováděny v TensorFlow s grafy toku dat. Grafy obsahují uzly a hrany. Uzly představují matematické operace, zatímco okraje představují data.

TensorFlow je užitečný pro výzkum a výrobu. Byla vytvořena s ohledem na to, že by mohla běžet na více procesorech nebo GPU a dokonce i na mobilních operačních systémech. To by mohlo být implementováno v Pythonu, C ++, R a Java.

-

Rychle:

Presto je open source SQL engine vyvinutý společností Facebook, který je schopen zpracovat petabajty dat. Na rozdíl od Hive, Presto nezávisí na technice MapReduce, a tedy rychleji při získávání dat. Jeho architektura a rozhraní jsou dostatečně snadné pro interakci s jinými systémy souborů.

Vzhledem k nízké latenci a snadnému interaktivnímu dotazu je v dnešní době velmi populární pro zpracování velkých dat.

-

Polybase:

Polybase pracuje na vrcholu SQL Serveru pro přístup k datům uloženým v PDW (Parallel Data Warehouse). PDW vytvořený pro zpracování libovolného objemu relačních dat a poskytuje integraci s Hadoop.

-

Úl:

Hive je platforma používaná pro dotazování dat a analýzu dat přes velké datové sady. Poskytuje dotazovací jazyk podobný SQL s názvem HiveQL, který se interně převede na MapReduce a poté se zpracuje.

Díky rychlému růstu dat a obrovskému úsilí organizace o analýzu velkých dat přinesla technologie na trh tolik vyzrálých technologií, že jejich znalost je obrovským přínosem. V současnosti Big Data Technology řeší mnoho obchodních potřeb a problémů zvýšením provozní efektivity a předpovídáním příslušného chování. Kariéra v oblasti velkých dat a souvisejících technologií může člověku i podnikům otevřít mnoho příležitostí.

Od této chvíle je nejvyšší čas přijmout velké datové technologie.

Doporučené články

Toto byl průvodce Co je Big Data Technology. Zde jsme probrali několik velkých datových technologií, jako je Hive, Apache Kafka, Apache Beam, ELK Stack atd. Další informace naleznete také v následujícím článku -

- Co je hluboké učení?

- Průvodce po Minitab?

- Co je technologie Salesforce?

- Co je Big Data Analytics?