Úvod do klasifikačních algoritmů

Tento článek o klasifikačních algoritmech uvádí přehled různých klasifikačních metod běžně používaných v technikách dolování dat s různými principy. Klasifikace je technika, která kategorizuje data do odlišného počtu tříd a ke každé třídě je přiřazen štítek. Hlavním cílem klasifikace je identifikovat třídu pro spouštění nových dat pomocí analýzy tréninkové sady s ohledem na správné hranice. Obecně se predikce cílové třídy a výše uvedeného procesu nazývá klasifikace.

Například vedení nemocnice zaznamenává jméno pacienta, jeho adresu, věk, předchozí anamnézu zdraví pacienta k jejich diagnostice, což pomáhá při klasifikaci pacientů. Lze je charakterizovat do dvou fází: fáze učení a fáze hodnocení. Modely učení fáze přístupová základna poskytuje data školení, zatímco fáze hodnocení předpovídá výstup pro dané údaje. Jejich aplikace jsme našli v e-mailovém spamu, predikci bankovních půjček, rozpoznávání řeči, analýze sentimentu. Tato technika zahrnuje matematickou funkci f se vstupem X a výstupem Y.

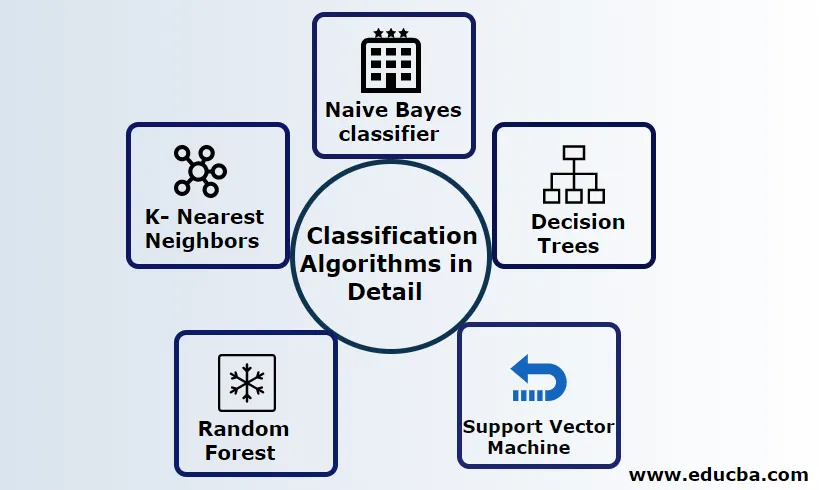

Vysvětlete podrobně klasifikační algoritmy

Klasifikaci lze provést na strukturovaných i nestrukturovaných datech. Zařazení lze rozdělit do

- Klasifikátor Naive Bayes

- Rozhodovací stromy

- Podpora Vector Machine

- Náhodný les

- K- Nejbližší sousedé

1) Klasifikátor Naive Bayes

Je to algoritmus založený na Bayesově teorému, jedna ze statistických klasifikací a pro odhad parametrů také známých jako pravděpodobnostní klasifikátory vyžaduje jen málo údajů o tréninku. Je považován za nejrychlejší klasifikátor, vysoce škálovatelný a zpracovává diskrétní i spojitá data. Tento algoritmus používal k vytvoření predikce v reálném čase. Existují různé typy naivního klasifikátoru, multinomiální naivní zátoky, Bernoulli naivní zátoky, gaussovské naivní.

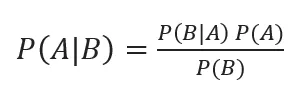

Bayesovská klasifikace s pravděpodobnostmi zadními je dána

Kde A, B jsou události, P (A | B) - Zadní pravděpodobnosti.

Pokud jsou dvě hodnoty na sobě nezávislé,

P (A, B) = P (A) P (B)

Naivní Bayes lze stavět pomocí knihovny python. Naivské prediktory jsou nezávislé, ačkoli se používají v systémech doporučení. Používají se v mnoha aplikacích v reálném čase a dobře se používají při klasifikaci dokumentů.

Výhody:

Výhody spočívají v tom, že vyžadují velmi menší výpočetní výkon, který se předpokládá při problémech s predikcí více tříd, přesně pracují na velkých souborech dat.

Nevýhoda:

Hlavní nevýhodou tohoto klasifikátoru je přiřazení nulové pravděpodobnosti. A mají funkce, které jsou na sobě nezávislé.

2) Rozhodovací strom

Jedná se o model přístupu shora dolů se strukturou vývojového diagramu zpracovávajícího vysokorozměrná data. Výsledky jsou předpovídány na základě dané vstupní proměnné. Rozhodovací strom složený z následujících prvků: Kořen, mnoho uzlů, větví, listí. Kořenový uzel provede oddíl na základě hodnoty atributu třídy, vnitřní uzel vezme atribut pro další klasifikaci, větve učiní rozhodovací pravidlo pro rozdělení uzlů na listové uzly, konečně, listové uzly nám poskytnou konečný výsledek. Časová složitost rozhodovacího stromu závisí na počtu záznamů, atributech tréninkových dat. Pokud je strom rozhodování příliš dlouhý, je obtížné získat požadované výsledky.

Výhoda: Používají se pro prediktivní analýzu k řešení problémů a používají se v každodenních činnostech k výběru cíle na základě analýzy rozhodnutí. Automaticky vytvoří model na základě zdrojových dat. Nejlépe zpracovat chybějící hodnoty.

Nevýhoda: Velikost stromu je nekontrolovatelná, dokud nemá určitá kritéria pro zastavení. Strom je kvůli své hierarchické struktuře nestabilní.

3) Podpora Vector Machine

Tento algoritmus hraje zásadní roli v klasifikačních problémech a nejznámějších algoritmech strojového učení. Je to důležitý nástroj používaný výzkumníkem a vědcem v oblasti dat. Tento SVM je velmi snadný a jeho procesem je nalezení hyperplochy v datových bodech N-dimenzionálního prostoru. Hyperplanes jsou hranice rozhodnutí, které klasifikují datové body. Celý tento vektor klesá blíže k hyperplánu, maximalizuje okraj klasifikátoru. Pokud je marže maximální, nejnižší je chyba generalizace. Jejich implementaci lze provést pomocí jádra pomocí pythonu s některými tréninkovými datovými sadami. Hlavním cílem SVM je vycvičit objekt do určité klasifikace. SVM není omezeno na to, aby se stalo lineárním klasifikátorem. SVM je upřednostňován více než jakýkoli klasifikační model kvůli své funkci jádra, která zlepšuje výpočetní účinnost.

Výhoda: Jsou velmi výhodné pro svou menší výpočetní sílu a efektivní přesnost. Efektivní ve velkém prostoru, dobrá účinnost paměti.

Nevýhoda: Omezení rychlosti, jádra a velikosti

4) Random Forest

Je to výkonný algoritmus strojového učení založený na přístupu Ensemble learning. Základním stavebním kamenem náhodného lesa je strom rozhodování používaný k vytváření prediktivních modelů. Ukázka práce zahrnuje vytvoření doménové struktury náhodných rozhodovacích stromů a prořezávání se provádí nastavením zastavovacích mezer, aby bylo dosaženo lepších výsledků. Náhodný les je implementován technikou zvanou pytlování pro rozhodování. Toto zabalení zabraňuje nadměrnému přizpůsobení dat snížením předpětí podobně, jako tato náhodná může dosáhnout lepší přesnosti. Konečnou predikci přijímá průměr mnoha rozhodovacích stromů, tj. Časté předpovědi. Náhodný les zahrnuje mnoho případů použití, jako jsou předpovědi akciového trhu, detekce podvodů, předpovědi zpráv.

Výhody:

- Nevyžaduje žádné velké zpracování ke zpracování datových sad a velmi snadný model sestavení. Poskytuje větší přesnost a pomáhá při řešení predikčních problémů.

- Funguje dobře při řešení chybějících hodnot a automaticky detekuje odlehlé hodnoty.

Nevýhoda:

- Vyžaduje vysoké výpočetní náklady a vysokou paměť.

- Vyžaduje mnohem více času.

5) K- Nejbližší sousedé

Zde budeme diskutovat algoritmus K-NN s dohledem učeným pro CART. Využívají K pozitivní malé celé číslo; objekt je přiřazen ke třídě na základě sousedů, nebo řekneme přiřazení skupiny pozorováním, ve které skupině soused leží. To se volí podle vzdálenosti euklidovské vzdálenosti a hrubou silou. Hodnotu K lze zjistit pomocí procesu ladění. KNN nemá raději naučit se žádný model pro trénování nového datového souboru a používat normalizaci pro změnu měřítka dat.

Výhoda: Poskytuje efektivní výsledky, pokud jsou údaje o školení obrovské.

Nevýhoda: Největším problémem je, že pokud je proměnná malá, funguje to dobře. Za druhé, výběr K faktor při klasifikaci.

Závěr

Závěrem jsme prošli schopnostmi různých klasifikačních algoritmů, které stále fungují jako mocný nástroj v konstrukci prvků, klasifikace obrazu, která hraje skvělý zdroj pro strojové učení. Klasifikační algoritmy jsou výkonné algoritmy, které řeší těžké problémy.

Doporučené články

Toto je průvodce klasifikačními algoritmy ve strojovém učení. Zde diskutujeme, že Klasifikace může být provedena jak na strukturovaných, tak nestrukturovaných datech. Můžete si také prohlédnout naše další doporučené články -

- Algoritmy směrování

- Clustering Algorithm

- Proces dolování dat

- Algoritmy strojového učení

- Nejpoužívanější techniky učení souboru

- Algoritmus C ++ | Příklady algoritmu C ++