Úvod do jednoduché lineární regrese

Z Slovník : Návrat do bývalého nebo méně rozvinutého stavu.

Ve statistice: Míra vztahu mezi střední hodnotou jedné proměnné a odpovídajícími hodnotami ostatních proměnných.

Regrese, ve které je vztah mezi vstupní proměnnou (nezávislá proměnná) a cílovou proměnnou (závislá proměnná) považován za lineární, se nazývá lineární regrese. Jednoduchá lineární regrese je typ lineární regrese, kde máme pouze jednu nezávislou proměnnou, která předpovídá závislou proměnnou. Jednoduchá lineární regrese je jedním z algoritmů strojového učení. Jednoduchá lineární regrese patří do rodiny supervidovaného učení. Regrese se používá pro predikci spojitých hodnot.

Model jednoduché lineární regrese

Udělejme to jednodušší. Jak to vše začalo?

Všechno to začalo v roce 1800 Francisem Galtonem. Studoval výškový vztah mezi otci a jejich syny. Všiml si vzoru: Buď je výška syna tak vysoká jako výška jeho otce, nebo jeho výška bude mít tendenci být blíž k celkové průměrné výšce všech lidí. Tento jev není nic jiného než regrese.

Například Shaq O'Neal je velmi slavný hráč NBA a je vysoký 2, 16 metrů. Jeho synové Shaqir a Shareef O'neal mají výšku 1, 96 metrů a 2, 06 metrů. Průměrná výška obyvatelstva je 1, 76 metrů. Synův výškový regres (posun směrem k) střední výšce.

Jak děláme regresi?

Výpočet regrese pouze se dvěma datovými body:

Vše, co chceme udělat, abychom našli nejlepší regresi, je nakreslit čáru, která je co nejblíže každé tečce. V případě dvou datových bodů je snadné nakreslit čáru, stačí se k nim připojit.

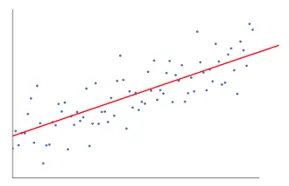

Nyní, když máme několik datových bodů, jak nakreslit čáru, která je co nejblíže každému datovému bodu.

V tomto případě je naším cílem minimalizovat vertikální vzdálenost mezi čarou a všemi datovými body. Tímto způsobem předpovídáme nejlepší linii pro náš lineární regresní model.

Jaká jednoduchá lineární regrese je?

Níže je uvedeno podrobné vysvětlení jednoduché lineární regrese:

- Nakreslí spoustu a mnoho možných čar a pak provede jakoukoli z těchto analýz.

- Součet čtverců chyb.

- Součet absolutních chyb.

- metoda nejmenších čtverců … atd

- Pro naši analýzu použijeme metodu nejmenších čtverců.

- Změníme všechny body a vypočítáme druhou mocninu součtu všech bodů. Bez ohledu na to, který řádek udává minimální částku, bude to nejlepší.

Například: Tímto bychom mohli vzít více mužů a jejich syna do výšky a dělat věci, jako je říkat člověku, jak vysoký může být jeho syn. než se vůbec narodil.

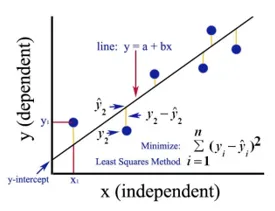

Obrázek Google

Výše uvedený obrázek ukazuje jednoduchou lineární regresi. Čára představuje regresní čáru. Dáno: y = a + b * x

Kde y je závislá proměnná (DV): Například, jak se mění plat osoby v závislosti na počtu let zkušeností, které má zaměstnanec. Takže zde bude platem zaměstnance nebo osoby závislá proměnná.

Závislá proměnná je naše cílová proměnná, ta, kterou chceme předpovědět pomocí lineární regrese.

x je naše nezávislá proměnná (IV): Závislá proměnná je příčinou proměnné nezávislé na změně. Ve výše uvedeném příkladu je naše závislá proměnná počet let praxe, protože počet let praxe způsobuje změnu platu zaměstnance.

- b je proměnná koeficientu pro naši nezávislou proměnnou x. Tento koeficient hraje zásadní roli. Říká, jak změna jednotky v x (IV) ovlivní y (DV). Nazývá se také koeficient proporcionality. Pokud jde o matematiku, je jen na vás, zda se jedná o sklon čáry, nebo můžete říci strmá čára.

- V našem příkladu, je-li sklon (b) menší, což znamená, že počet let přinese menší přírůstek platu na druhé straně, pokud sklon (b) je vyšší, přinese vysoké zvýšení platu se zvýšením počtu roky zkušeností.

- a je konstantní hodnota. To je také označováno jako přestávka, to je místo, kde čára protíná osu y nebo osu DV. Jiným způsobem můžeme říci, že má-li zaměstnanec nulovou zkušenost (x), pak bude plat (y) pro daného zaměstnance konstantní (a).

Jak funguje nejmenší náměstí?

Níže jsou uvedeny body za nejméně čtvercovou práci:

- Nakreslí libovolnou čáru podle datových trendů.

- Bere datové body a kreslí svislé čáry. Považuje vertikální vzdálenost za parametr.

- Tyto svislé čáry proříznou regresní čáru a poskytují odpovídající bod pro datové body.

- Poté najde vertikální rozdíl mezi každým datovým bodem a jeho odpovídajícím datovým bodem na regresní linii.

- Vypočítá chybu, která je druhou mocninou rozdílu.

- Poté vypočítá součet chyb.

- Poté znovu nakreslí čáru a zopakuje výše uvedený postup.

- Tímto způsobem nakreslí několik řádků a jako nejlepší řádek se vybere řádek, který dává nejmenší součet chyb.

- Tato nejlepší linie je naše jednoduchá lineární regresní linie.

Aplikace jednoduché lineární regrese

Pro predikci spojité proměnné se provádí regresní analýza. Regresní analýza má širokou škálu aplikací. Některé příklady jsou následující:

- Prediktivní analýza

- Efektivnost marketingu,

- stanovení ceny jakéhokoli výpisu

- predikce propagace produktu.

Zde budeme diskutovat o jedné aplikaci lineární regrese pro prediktivní analýzu. Provedeme modelování pomocí pythonu.

Kroky, které hodláme sestavit, jsou následující:

- Budeme importovat knihovny a datové sady.

- Data předběžně zpracujeme.

- Data rozdělíme do testovací sady a tréninkové sady.

- Vytvoříme model, který se bude snažit předpovídat cílovou proměnnou na základě naší tréninkové sady

- Budeme předpovídat cílovou proměnnou pro testovací sadu.

- Budeme analyzovat výsledky předpovídané modelem

Pro naši analýzu použijeme datový soubor platů s údaji 30 zaměstnanců.

# Import knihoven

import numpy as np

import matplotlib.pyplot as plt

import pandas as pd

# Import datového souboru (Ukázka dat je uvedena v tabulce)

dataset = pd.read_csv('Salary_Data.csv')

| roky zkušeností | Plat |

| 1.5 | 37731 |

| 1.1 | 39343 |

| 2.2 | 39891 |

| 2 | 43525 |

| 1.3 | 46205 |

| 3.2 | 54445 |

| 4 | 55749 |

# Předzpracování datového souboru, zde rozdělíme datovou sadu na závislou proměnnou a nezávislou proměnnou. x jako nezávislý a y jako závislá nebo cílová proměnná

X = dataset.iloc(:, :-1).values

y = dataset.iloc(:, 1).values

# Rozdělení datového souboru do tréninkové sady a testovací sady:

from sklearn.model_selection import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size = 1/3, random_state = 0)

Zde testovací velikost 1/3 ukazuje, že z celkových údajů 2/3 část je pro trénink modelu a zbytek 1/3 se používá pro testování modelu.

# Pojďme přizpůsobit náš jednoduchý lineární regresní model do tréninkové sady

from sklearn.linear_model import LinearRegression

regressor = LinearRegression()

regressor.fit(X_train, y_train)

Model lineární regrese je nyní proškolen. Tento model bude použit pro predikci závislé proměnné.

# Predikce výsledků testu

y_pred = regressor.predict(X_test)

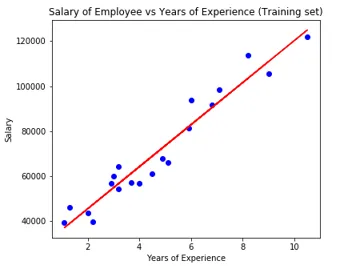

# Vizualizace výsledků testu

plt.scatter(X_test, y_test, color = 'blue')

plt.plot(X_train, regressor.predict(X_train), color = 'red')

plt.title('Salary of Employee vs Experience (Test set)')

plt.xlabel('Years of Experience')

plt.ylabel('Salary')

plt.show()

# Parametr modelu

print(regressor.intercept_)

print(regressor.coef_)

26816.19224403119

(9345.94244312)

Takže hodnota interceptoru (a) je 26816. Což naznačuje, že jakákoli čerstvější (nulová zkušenost) by byla asi 26816 částkou jako plat.

Koeficient pro náš model vyšel jako 9345, 94. To naznačuje, že udržení všech ostatních parametrů konstantní, změna v jedné jednotce nezávislé proměnné (roky exp.) Přinese změnu 9345 jednotek v platu.

Metriky hodnocení regrese

Pro regresní analýzu jsou v zásadě k dispozici 3 důležité metriky hodnocení:

- Střední absolutní chyba (MAE): Zobrazuje průměr absolutních chyb, což je rozdíl mezi předpokládanou a skutečnou.

- Střední kvadratická chyba (MSE): Zobrazuje průměrnou hodnotu kvadratických chyb.

- Root Mean Squared Error (RMSE): Ukazuje druhou odmocninu střední chyby na druhou.

Výše uvedené metody můžeme porovnat:

- MAE: Ukazuje průměrnou chybu a nejjednodušší ze všech tří metod.

- MSE: Tento je populárnější než MAE, protože zvyšuje větší chyby, což ve výsledku ukazuje více poznatků.

- RMSE: Tento je lepší než MSE, protože chybu můžeme interpretovat z hlediska y.

Tyto 3 nejsou ničím jiným než ztrátovými funkcemi.

# Hodnocení modelu

from sklearn import metrics

print('MAE:', metrics.mean_absolute_error(y_test, y_pred))

print('MSE:', metrics.mean_squared_error(y_test, y_pred))

print('RMSE:', np.sqrt(metrics.mean_squared_error(y_test, y_pred)))

MAE: 3426.4269374307123

MSE: 21026037.329511296

RMSE: 4585.4157204675885

Závěr

Lineární regrese je výkonný nástroj pro algoritmy strojového učení, který se používá pro predikci spojitých proměnných, jako je plat, prodej, výkon atd. Lineární regrese bere v úvahu lineární vztah mezi nezávislými a závislými proměnnými. Jednoduchá lineární regrese má pouze jednu nezávislou proměnnou, na jejímž základě model předpovídá cílovou proměnnou. Diskutovali jsme o modelu a použití lineární regrese s příkladem prediktivní analýzy pro predikci platu zaměstnanců.

Doporučené články

Toto je průvodce jednoduchou lineární regresí. Zde diskutujeme model a použití lineární regrese pomocí příkladu prediktivní analýzy pro predikci mezd zaměstnanců. Další informace naleznete také v dalších souvisejících článcích.

- Lineární regresní analýza

- Lineární regrese v R

- Lineární regresní modelování

- Nástroje pro regresní testování

- Matplotlib v Pythonu | Top 14 pozemků v Matplotlibu

- Slovník v Pythonu Metody a příklady

- Příklady Square Root v PHP

- Lineární regrese vs. logická regrese Nejlepší rozdíly